05:54 م

الثلاثاء 06 يونيو 2023

(مصراوي):

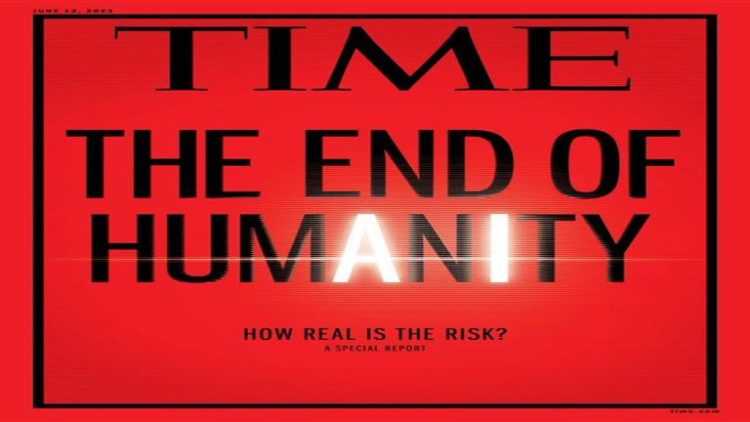

في أحدث أعدادها، تناولت مجلة “تايم” الأمريكية، مخاطر الذكاء الاصطناعي على عالمنا، متسائلة حول مدى خطره على سيطرة بل ووجود البشر.

وحمل غلاف المجلة عنوانا رئيسيا “نهاية البشرية”، وتضمنت ملفا خاصا يتساءل “ما حقيقة الخطر؟” الذي يشكله الذكاء الاصطناعي.

وطرح دان هيندريكس، مدير مركز أمان الذكاء الاصطناعي، في مقال بالمجلة، مخاوفه بشأن زيادة استقلالية أنظمة الذكاء الاصطناعي وما ينتج عنها من زيادة سيطرتهم على القرارات الرئيسية التي تؤثر على عالمنا.

وأصدر تحالف عريض من خبراء الذكاء الاصطناعي مؤخرًا بيانًا عامًا يحذر من “خطر الانقراض بسبب الذكاء الاصطناعي”.

يقول دان: “هناك طرق عديدة لتصبح أنظمة الذكاء الاصطناعي بمثابة مخاطر جسيمة على البشرية، ولا تزال الطبيعة الدقيقة للمخاطر محل نقاش، لكن تخيل مديرًا تنفيذيًا يكتسب مساعدًا للذكاء الاصطناعي. يبدأون بإعطائه مهاما بسيطة ومنخفضة المستوى، مثل صياغة رسائل البريد الإلكتروني واقتراح عمليات الشراء. مع تحسن الذكاء الاصطناعي بمرور الوقت، يصبح تدريجياً أفضل بكثير في هذه الأشياء من موظفيهم. لذلك يتم ترقية الذكاء الاصطناعي. بدلاً من صياغة رسائل البريد الإلكتروني، يتمتع الآن بالسيطرة الكاملة على البريد الوارد. بدلاً من اقتراح عمليات شراء، يُسمح في النهاية بالوصول إلى الحسابات المصرفية وشراء الأشياء تلقائيًا”.

وأوضح: “في البداية، يراقب الرئيس التنفيذي العمل بعناية، ولكن مع مرور الأشهر دون أخطاء، يتلقى الذكاء الاصطناعي إشرافًا أقل ومزيدًا من الاستقلالية باسم الكفاءة. يخطر ببال المدير التنفيذي أنه نظرًا لأن الذكاء الاصطناعي جيد جدًا في هذه المهام، فيجب أن يأخذ نطاقًا أوسع من الأهداف المفتوحة: (تصميم النموذج التالي في خط الإنتاج)، أو (التخطيط لحملة تسويقية جديدة)، أو (استغلال الثغرات الأمنية في أنظمة الكمبيوتر الخاصة بالمنافس). يلاحظ الرئيس التنفيذي كيف تتخلف الشركات ذات الاستخدام المقيد لأنظمة الذكاء الاصطناعي، ويتم تحفيزها بشكل أكبر لتسليم المزيد من القوة إلى الذكاء الاصطناعي مع إشراف أقل. الشركات التي تقاوم هذه الاتجاهات لا تحظى بفرصة”.

وأضاف: “في النهاية، حتى دور الرئيس التنفيذي هو دور رمزي إلى حد كبير. تدار الاقتصادات من قبل شركات الذكاء الاصطناعي المستقلة، وتدرك البشرية بعد فوات الأوان أننا فقدنا السيطرة”.

لن تنطبق هذه الديناميكيات التنافسية نفسها على الشركات فحسب، بل على الدول أيضًا –بحسب الكاتب- فمع زيادة استقلالية أنظمة الذكاء الاصطناعي، تزداد سيطرتها على القرارات الرئيسية التي تؤثر على المجتمع. وإذا حدث ذلك فسوف يعتمد مستقبلنا بشكل كبير على طبيعة عوامل الذكاء الاصطناعي.

وقارن الكاتب بين تطور البشر وتطور خوارزميات توصية المحتوى التي تستخدمها منصات التواصل الاجتماعي وخدمات البث، لتسبب جذب وإدمان لدى المستخدمين، ثم يتم تحسينها لتكون أكثر فاعلية، بينما يتم إيقاف الخوارزميات التي تفشل في جذب الانتباه، وهو ما يعزز بقاء الديناميكية الأكثر إدمانًا.

ولفت إلى أن المنصات التي تستخدم الأساليب الإدمانية تتفوق على التي ترفض ذلك، مما يؤدي إلى سباق نحو القاع بين المنافسين، وأضرار جسيمة للمجتمع.

في العالم البيولوجي، التطور عملية بطيئة بالنسبة للبشر، حيث يستغرق الإنسان تسعة أشهر لتكوينه وحوالي 20 عامًا من التربية والتعليم لإخراج جيل بالغ قادرًا على العمل بكامل طاقته، لكن يمكن للذكاء الاصطناعي، غير المقيّد بالبيولوجيا، أن يتكيف -وبالتالي يتطور- بشكل أسرع من ذباب الفاكهة الذي يتطور في أقل من 10 أيام.

يستعرض دان 3 دوافع للقلق بشأن الذكاء الاصطناعي؛ الأول هو أن تأثيرات الاختيار تجعل من الصعب التحكم في الذكاء الاصطناعي، فبعد أن كان يتحدث العلماء عن “تصميم” أنظمة الذكاء الاصطناعي، أصبحوا يتحدثون الآن عن “توجيهها”، وحتى قدرتنا على التوجيه تخرج عن متناول أيدينا لأننا نسمح للذكاء الاصطناعي بتعليم أنفسهم والتصرف بشكل متزايد بطرق لا يفهمها حتى صانعوها.

أما الدافع الثاني: هو أن التطور يميل إلى إنتاج “سلوك أناني”، إذ أوضح دان: “قد تختار المنافسة غير الأخلاقية بين أنظمة الذكاء الاصطناعي سمات غير مرغوب فيها. ستسود أنظمة الذكاء الاصطناعي التي تكتسب التأثير بنجاح وتوفر قيمة اقتصادية، لتحل محل أنظمة الذكاء الاصطناعي التي تعمل بطريقة أكثر ضيقًا وقيودًا، حتى لو كان ذلك على حساب خفض حواجز الحماية وتدابير السلامة”.

السبب الثالث بحسب دان، هو أن التطور يمكنه إرباك الذكاء الاصطناعي بسلوكيات تعزز الدفاع على الذات، وبالتالي يأتي السؤال حول إيقاف الذكاء الاصطناعي بسهولة.

يحذر دان من تنازل البشر عن المزيد من السلطة لأنظمة الذكاء الاصطناعي التي لا يمكن التحكم فيها بشكل موثوق، قائلاً إنه حتى الآن “لا توجد حلول سهلة مؤكدة لهذا المأزق”.